LLM 환각 현상 해결 방법, 제미나이 3.0 데이터 접지 전략 공개

최근 거대 언어 모델(LLM)은 놀라운 언어 구사 능력으로 많은 분야에서 혁신을 이끌고 있지만, 사실과 무관한 정보를 마치 진실인 것처럼 생성하는 LLM 환각 현상은 여전히 상업적 도입에 있어 가장 큰 걸림돌입니다. 특히 제미나이 3.0(Gemini 3.0)과 같은 최신 모델을 금융, 의료 등 신뢰성이 중요한 분야에 적용하려면 이 환각 현상을 근본적으로 해결해야 합니다. 많은 개발자와 기업들이 이 문제를 해결하기 위해 데이터 접지 전략에 집중하고 있습니다. 단순한 프롬프트 엔지니어링을 넘어, 외부의 검증된 지식에 모델의 응답을 '접지(Grounding)'시키는 이 전략은 모델의 신뢰성을 높이는 결정적인 열쇠가 됩니다. 이번 글에서는 제미나이 3.0이 보여준 데이터 접지 전략의 핵심 원리와 함께, LLM 환각 현상 해결 방법의 구체적인 기술들을 깊이 있게 살펴보겠습니다.

목차

1. 데이터 접지 전략의 핵심: 검색 증강 생성(RAG)의 진화

2. 제미나이 3.0과 함께 신뢰성을 높이는 데이터 접지 전략

3. 데이터 접지를 통한 기업의 LLM 신뢰성 확보 방안

4. 자주 묻는 질문

데이터 접지 전략의 핵심: 검색 증강 생성(RAG)의 진화

데이터 접지(Data Grounding)란 LLM이 답변을 생성할 때 내부 지식에만 의존하지 않고, 외부의 신뢰할 수 있는 데이터 소스(예: 기업 데이터베이스, 실시간 웹 검색 결과, 문서)를 검색하여 그 사실에 근거하여 답변하도록 만드는 일련의 과정입니다. 이 전략의 대표적인 기술이 바로 검색 증강 생성(Retrieval-Augmented Generation, RAG)입니다.

RAG는 사용자 질문이 들어오면, 먼저 벡터 데이터베이스 등에서 가장 관련성이 높은 외부 문서 조각들을 검색(Retrieval)하고, 이 검색된 문맥(Context)을 LLM의 프롬프트에 추가하여 답변을 생성(Generation)하도록 유도합니다. 이 과정을 통해 LLM 환각 현상 해결 방법 중 가장 효과적인 방법으로 인정받고 있으며, LLM의 응답이 실제 데이터 소스에 '앵커링(Anchoring)'되어 신뢰성을 높이는 결과를 가져옵니다.

RAG 워크플로의 4단계

- 쿼리 변환: 사용자 질문을 벡터화하여 검색에 적합하게 변환합니다.

- 문서 검색: 변환된 벡터를 이용해 외부 지식 기반(Knowledge Base)에서 가장 유사한 문맥 조각들을 검색합니다.

- 프롬프트 증강: 검색된 문맥과 원래의 질문을 조합하여 LLM에게 전달할 최종 프롬프트를 만듭니다.

- 접지된 답변 생성: LLM은 제공된 문맥만을 기반으로 답변을 생성하며, 이는 데이터 접지 전략의 핵심입니다.

제미나이 3.0은 특히 구글 검색(Google Search)과의 긴밀한 통합을 통해 이 RAG 기술을 극대화했습니다. 실시간 웹 검색 데이터에 모델의 답변을 접지시킴으로써 최신 정보에 대한 정확도를 높이고, 멀티모달 능력(텍스트, 이미지 등 동시 이해)을 활용하여 기업의 복잡한 문서나 데이터에 대한 접지 성능을 향상시켰습니다. 이러한 데이터 접지 전략의 발전은 LLM 환각 현상 해결 방법의 새로운 표준을 제시하고 있습니다.

제미나이 3.0과 함께 신뢰성을 높이는 데이터 접지 전략

제미나이 3.0이 보여주는 강력한 추론 능력과 긴 컨텍스트 윈도우(Context Window)는 RAG 기반의 데이터 접지 전략을 더욱 정교하게 만듭니다. 단순히 정보를 검색하는 것을 넘어, 검색된 정보를 비판적으로 분석하고 통합하여 답변의 신뢰성을 높이는 데 중점을 둡니다. 다음은 신뢰성을 높이는 데이터 접지 전략의 구체적인 방법들입니다.

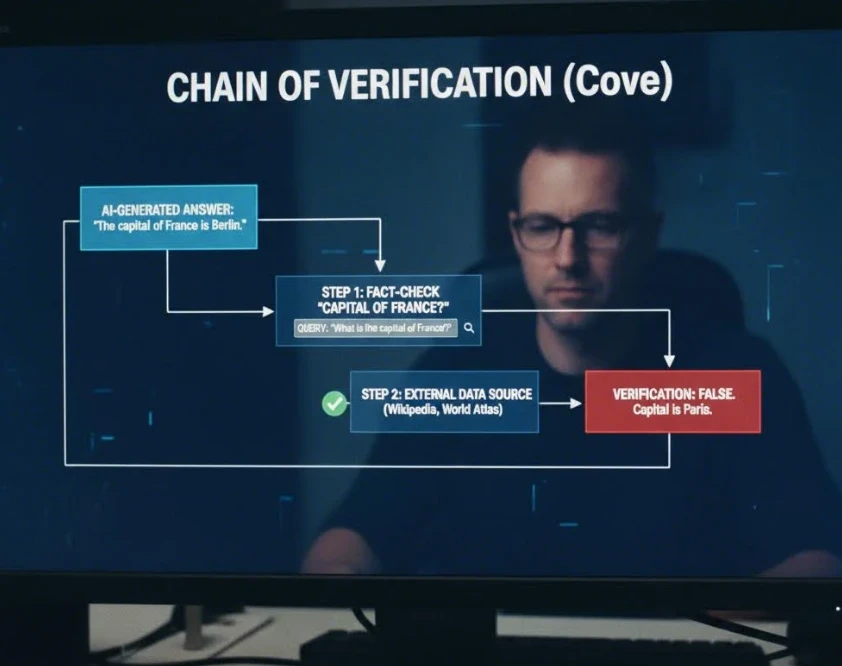

1. 검증 체인(Chain of Verification, CoVe) 및 자체 일관성

- 개념: 모델이 초기 답변을 생성한 후, 스스로 검증 질문 목록을 만들어 답변의 사실 여부를 검증하게 합니다. 이 검증 질문들은 외부 검색 엔진이나 신뢰할 수 있는 지식 기반에 다시 쿼리되어 사실적 증거를 수집합니다.

- 효과: LLM 환각 현상 해결 방법 중 가장 진보된 형태로, 모델이 자신의 답변을 객관적인 증거와 대조하여 신뢰성을 높이는 자가 수정 메커니즘을 제공합니다. 제미나이 3.0의 강력한 추론력은 이 검증 과정을 더 정교하고 빠르게 만듭니다.

2. 제약 조건 기반 프롬프트 엔지니어링

- 방법: 프롬프트에 명시적인 행동 제약 조건을 설정합니다. 예를 들어, “제공된 문맥에서만 답변하고, 정보가 부족하면 ‘정보 부족’이라고 명시하세요”와 같은 지침을 포함합니다. 또한, 'Few-shot examples'를 제공하여 모델이 정확한 답변의 구조와 스타일을 학습하도록 유도하여 신뢰성을 높이는 결과물을 도출합니다.

- 핵심: 제미나이 API 문서는 명확하고 간결하며 일관된 구조(예: XML 태그 사용)를 프롬프트에 사용할 것을 권장하며, 이는 모델이 예측 없이 LLM 환각 현상을 일으킬 가능성을 줄입니다.

모델의 랜덤성(Randomness)을 제어하는 것도 중요합니다. 온도를 낮추고(Temperature), Top-p와 Top-k 매개변수를 조정하면 모델의 창의성은 줄어들지만, 사실적 정확도가 높아져 신뢰성을 높이는 데 도움이 됩니다.

데이터 접지를 통한 기업의 LLM 신뢰성 확보 방안

기업 환경에서 LLM 환각 현상은 재정적 손실이나 법적 문제로 이어질 수 있어, 데이터 접지 전략은 선택이 아닌 필수입니다. 신뢰성을 높이는 데이터 접지 전략은 기업의 내부 데이터를 활용하는 RAG 파이프라인 구축에 초점을 맞춥니다.

1. 고품질 데이터 정제 및 벡터화:

- RAG의 성능은 데이터의 품질에 따라 결정됩니다. 노이즈가 없는 깨끗하고 검증된(Fact-checked) 내부 문서를 준비하고, 이를 효과적으로 검색할 수 있도록 벡터 임베딩을 통해 인덱싱해야 합니다.

- 도메인 특화 지식으로 미세 조정(Fine-Tuning)된 임베딩 모델을 사용하면 검색 정확도가 극적으로 향상됩니다.

2. 실시간 검증 및 감사 가능성(Auditability) 확보:

- 생성된 답변과 함께 해당 답변의 근거가 된 소스 문서의 출처(Grounding Support) 링크를 사용자에게 제공합니다. 이는 모델의 신뢰성을 높이는 투명성을 확보하며, 법률 및 규제 준수(Compliance)를 위한 감사(Auditing)를 가능하게 합니다.

- Amazon Bedrock의 Guardrails 기능처럼, 생성된 답변에 대한 환각 탐지(Hallucination Detection) 및 문맥 접지 검사(Contextual Grounding Checks)를 후처리 단계에 적용하여 최종 답변의 오류를 사전에 포착합니다.

3. 지식 그래프 통합:

- 단순 문서 검색을 넘어, 기업의 구조화된 데이터(예: 고객, 제품, 재고 관계)를 지식 그래프(Knowledge Graph) 형태로 구축하여 RAG와 결합합니다.

- 이는 LLM에게 사실적 정보뿐 아니라 개념 간의 관계까지 제공함으로써, 복잡한 추론 문제에서 LLM 환각 현상 해결 방법의 정확도를 30% 이상 향상시키는 것으로 보고됩니다.

자주 묻는 질문

지금까지 LLM 환각 현상 해결 방법의 핵심인 데이터 접지 전략과 제미나이 3.0을 활용한 신뢰성을 높이는 구체적인 방안들을 살펴보았습니다. 검색 증강 생성(RAG), 검증 체인(CoVe), 그리고 프롬프트 엔지니어링의 조합은 LLM의 불확실성을 획기적으로 낮춥니다. 특히 기업들은 내부 데이터에 모델을 확실히 접지시키고, 답변에 대한 투명한 출처를 제공함으로써 AI 시스템의 신뢰성을 높이는 데 주력해야 합니다.

이 글에 제시된 LLM 환각 현상 해결 방법과 데이터 접지 전략은 현재 기술 동향 및 전문가 의견을 기반으로 작성되었습니다. LLM 기술의 복잡성과 급변하는 환경으로 인해, 모든 정보는 참고 자료로만 활용하시고 중요한 시스템 구축 또는 서비스 결정에 앞서 반드시 전문적인 검토를 거치시기 바랍니다.